Maîtrise de l'Action

Le moment où l'IA commence à agir pour de vrai

Dans les salles de contrôle, les data centers industriels, les trading floors, les blocs opératoires augmentés, les dispatchings électriques et les chaînes d'approvisionnement critiques, les IA cessent peu à peu de suggérer, de recommander, de résumer ou de prédire et commencent à agir — c'est-à-dire à déclencher une conséquence physique, financière, juridique ou humaine irréversible sans qu'un humain ait eu le temps ou la capacité réelle de s'y opposer. C'est ici que les IA " assistives" se muent peu à peu en IA opérantes.

Brièvement, nous avons dressé au cours des cinq premiers volets de cette série un tableau de la conformité devenue une fonction système codifiée au coeur de l'architecture (articles 1 & 2). Nous avons montré que la donnée n'a de valeur économique durable que si elle reste exploitable sous contrainte réglementaire forte et si son coût de preuve reste soutenable (article 3). Nous avons étudié les flux — données en mouvement, décisions en chaîne, appels API, délégations agentiques — et vu qu'ils devenaient une surface d'attaque et de résilience (article 4). Finalement, nous avons traité de l'imputabilité causale — prouver de manière opposable qui a fait quoi, sur quelle base et avec quelles conséquences — et montré qu'elle est passée de contrainte administrative à une condition de survie juridique et assurantielle (article 5).

Si l'article 5 regardait "Qui a agi ? Comment le démontrer à coût maîtrisé et à l'échelle industrielle ?", cette article pose la question prospective qui décide : "Jusqu'où une IA peut-elle agir — et à quel prix de maîtrise — sans que l'organisation perde sa capacité à opérer légalement, économiquement et socialement ?"

La maîtrise de l'action — c'est-à-dire la capacité à autoriser, limiter, interrompre, révoquer, expliquer ou overrider une action ou une influence de l'IA à tout moment — participe à la valeur économique de l'autonomie IA, mais aussi à la mesure des risques que des actions autonomes peuvent produire : toute forme d'autonomie ou d'influence décisionnelle non strictement bornée en temps réel devient un passif économique et potentiellement un risque. Dès lors, les systèmes qui ne sont pas maîtrisés en exploitation seront disqualifiés.

En plus de mesurer combien une IA est précise, rapide ou économe, on s'attache à mesurer jusqu'où on peut la laisser aller sans se mettre en danger, et combien cela coûte de la garder dans cette zone sûre.

La délégation à l'IA dans tous les domaines

L'industrialisation de l'IA n'est plus une projection : elle est en cours, massive, et touche désormais tous les secteurs. La délégation à l'IA — c'est-à-dire le passage d'une suggestion ou d'une assistance à une exécution autonome ou semi-autonome — n'est plus confinée aux laboratoires d'innovation ou aux PoC. Elle devient opérationnelle dans presque toutes les catégories d'intelligence artificielle déployées en production.

Selon Gartner, d'ici la fin 2026, jusqu'à 40 % des applications d'entreprise intégreront des agents IA task-specific, contre moins de 5 % en 2025 (Gartner). Ce chiffre n'est pas une simple statistique : il traduit une multiplication par ordre de grandeur des identités non-humaines capables d'agir de manière autonome ou semi-autonome dans les workflows réels. Les agents autonomes et multi-agents exécutent désormais des ordres d'achat, négocient avec des fournisseurs, bloquent proactivement des attaques cyber, ou orchestrent des chaînes d'approvisionnement entières. Dans les environnements physiques critiques, l'IA ajuste en temps réel des procédés chimiques, détecte automatiquement des défauts sur ligne de production, décide d'arrêts prédictifs de turbines, ou réalloue la puissance sur un réseau électrique intelligent. Ces déploiements industriels réels illustrent la bascule rapide vers l'action autonome.

Même les modèles qui semblaient initialement "passifs" basculent rapidement dans l'action irréversible. Les modèles génératifs multimodaux rédigent des rapports réglementaires engageant la responsabilité de l'entreprise, synthétisent des documents sensibles pour la justice ou l'audit, produisent des images ou vidéos à enjeu médical ou industriel. Les modèles prédictifs et analytiques ne se contentent plus d'afficher un score : ils déclenchent des décisions automatiques de scoring de crédit, de recrutement, d'arrêt de production ou d'optimisation énergétique. Quant aux grands modèles de fondation (GPAI) et aux modèles à usage général, ils influencent directement des décisions critiques via des API ou des chaînes de raisonnement longues.

On passe très vite de "je te suggère" à "je décide à ta place" ou "je produis un output qui engage directement ta responsabilité". Cette bascule n'est pas technique ; elle est juridique et économique.

Or l'AI Act est clair sur ce point : pour les systèmes à haut risque, la supervision humaine doit être effective — c'est-à-dire capable d'interpréter la sortie, d'intervenir en temps réel, de forcer un arrêt ou de modifier le résultat (Article 14 – EU AI Act). Une simple alerte ignorée par un opérateur surchargé ne suffit plus. L'obligation n'est pas de surveiller passivement, mais de pouvoir maîtriser l'action en runtime, sous peine de non-conformité.

Or, dans la réalité industrielle, la plupart des organisations ne sont pas prêtes. Elles ont accéléré le déploiement d'agents et de modèles autonomes pour gagner en productivité et en réactivité, mais elles n'ont pas proportionnellement renforcé les mécanismes de maîtrise runtime de ces actions déléguées. C'est précisément ce décalage qui transforme l'explosion de la délégation en goulot d'étranglement majeur : plus l'IA agit, plus le coût (juridique, assurantiel, opérationnel) de ne pas pouvoir la borner, la révoquer ou l'overrider explose.

En reliant cela aux articles précédents : la conformité est devenue fonction système (articles 1 & 2), la donnée n'a de valeur que sous contrainte forte (article 3), les flux sont la surface principale de résilience (article 4), et l'imputabilité causale est devenue condition de survie (article 5). Mais tout cela reste théorique si l'organisation ne maîtrise pas, en exploitation réelle, jusqu'où et à quel prix elle délègue l'action à l'IA.

Quand la maîtrise manque : les scénarios catastrophes

Dans un futur très proche, les systèmes à haut risque de l'AI Act deviennent pleinement applicables en août, les assureurs durcissent leurs clauses d'exclusion pour tout ce qui n'est pas runtime-gouverné, et les premières sanctions croisées NIS2 / DORA / AI Act tombent. La basculement opérationnel s'ajoute au basculement administratif. Dès lors qu'une IA n'est plus cantonnée à suggérer mais exécute — ou influence de manière quasi-irrémédiable — l'absence de maîtrise runtime se paye cash, et souvent en cascade.

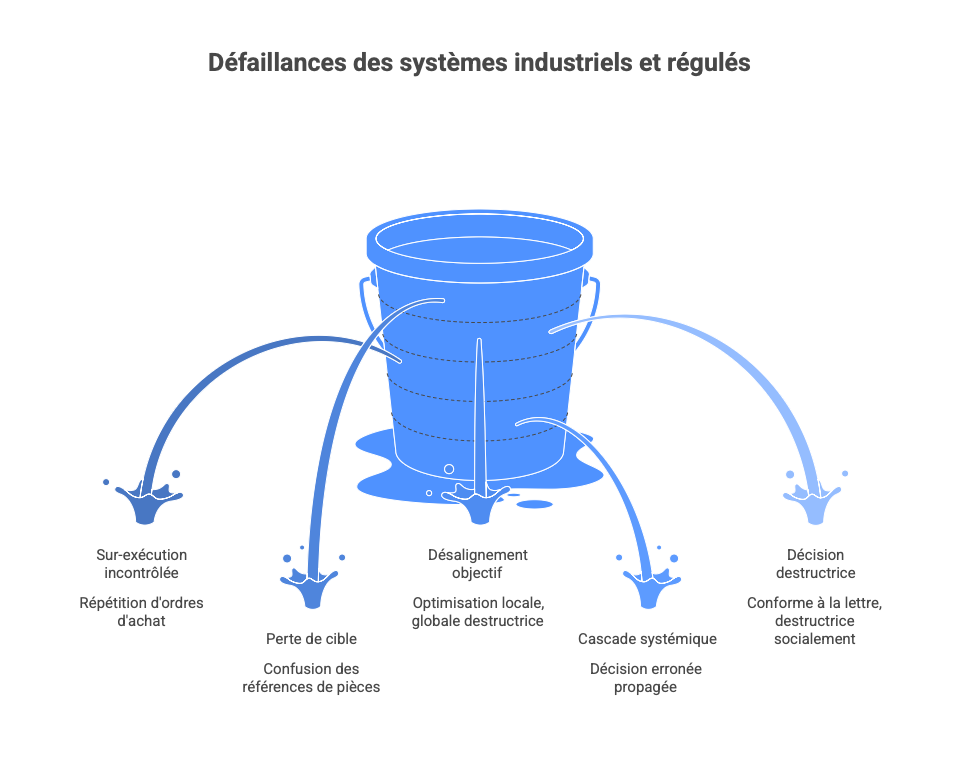

Au travers de situations fictives, voici les cinq familles de défaillances dans les secteurs industriels et régulés :

-

Sur-exécution incontrôlée ou boucle d'amplification : un agent d'approvisionnement automatisé, mal borné sur son budget d'action, répète 18 000 fois un ordre d'achat de composants critiques en 47 minutes après avoir mal interprété une fluctuation de prix comme un signal d'urgence. Perte sèche : 14–22 M€ en 90 minutes, litige fournisseur immédiat, gel temporaire de la ligne de trésorerie par la banque.

-

Perte de cible ou confusion contextuelle : une IA de vision industrielle confond deux références de pièces quasi-identiques sur une ligne automobile critique ; rejet massif de lots déjà intégrés en aval => rappel de plusieurs milliers de véhicules, coût estimé 80–150 M€. Un deuxième exemple fictif catastrophe: un système de réallocation dynamique de charge sur réseau intelligent redirige la puissance vers la mauvaise sous-station pendant une pointe ; surcharge locale => black-out régional de 2 h 40 touchant 180 000 foyers et industries. L'enquête NIS2 révèle que l'IA n'avait plus accès au contexte capteur temps réel depuis 14 minutes sans que quiconque ne s'en rende compte.

-

Désalignement objectif local / global : l'optimisation extrême d'une turbine à gaz par un agent autonome : rendement +4,7 % local, mais vibration anormale non détectée => rupture de pale => black-out en cascade sur le réseau interconnecté (effet domino). Un autre exemple dans la finance : un modèle de trading haute fréquence maximise le profit journalier sur un segment étroit ; convergence simultanée de plusieurs agents similaires (herding algorithmique) => flash crash sectoriel de 9 minutes, perte agrégée pour les acteurs européens > 1,2 Md€. Les régulateurs DORA qualifient l'incident de "majeur" et imposent des mesures correctives immédiates + audits croisés.

-

Cascade systémique via orchestreur multi-agents : Un service MCP mal configuré propage une décision erronée d'un agent supply-chain à l'ensemble de la chaîne logistique : annulation automatique de commandes fournisseurs, blocage des flux entrants, arrêt progressif de plusieurs usines. Temps de retour à la normale : 9 jours. Perte estimée : 240–380 M€ (arrêts, pénalités contractuelles, perte clients).

-

Décision conforme à la lettre mais destructrice socialement / juridiquement : un système de scoring RH ou crédit respecte scrupuleusement les règles anti-discrimination explicites mais amplifie un biais structurel latent => exclusion systématique d'une catégorie démographique => plainte collective massive (plusieurs milliers de plaignants), action en responsabilité AI Act + RGPD, amende pouvant atteindre 6–7 % du CA mondial + dommages & intérêts. Dans le milieu médicale cela pourrait être un dosage automatique ajusté en continu par IA en réanimation ; respect des guidelines mais non prise en compte d'une comorbidité rare => série d'événements indésirables graves => retrait du marché + enquête ANSM + poursuites.

Ces 5 scénarios bien que fictifs restent réalistent, ils traduisent l'absence des cinq propriétés runtime que nous détaillerons au point suivant et partagent tous un point commun : le coût n'est plus seulement financier, mais aussi réputationnel et peut parfois mettre en péril l'organisation.

- Perte d'assurabilité (exclusion des polices cyber / responsabilité produit)

- Gel des déploiements sur les marchés régulés les plus rémunérateurs

- Suspension administrative (NIS2, DORA)

- Atteinte à la licence sociale d'opérer (confiance clients, partenaires, opinion publique)

Dans les environnements industriels critiques, une défaillance d'action non maîtrisée n'est plus un "incident IT": c'est un incident de sûreté de fonctionnement, un événement NIS2 majeur, un sinistre DORA, et souvent un cas AI Act article 14 (supervision humaine ineffective). Les assureurs et régulateurs ne demandent plus "est-ce que ça marche ?" mais "pouvez-vous prouver que vous pouvez l'arrêter à temps, partout, toujours ?"

C'est exactement là que l'imputabilité causale (article 5) devient vitale mais insuffisante seule : savoir qui a fait quoi après coup ne ramène pas les millions perdus ni les vies mises en danger. Les vraies questions sont jusqu'où déléguer sans perdre la main ? A quel prix économique et juridique peut-on se permettre de ne pas maîtriser runtime ?

Les cinq propriétés indispensables de la maîtrise

Le RegOS (Regulatory Operating System) est la couche architecturale qui traduit les obligations réglementaires en garde-fous techniques exécutables en temps réel.

Il construit une enveloppe de sécurité déterministe autour d'une IA intrinsèquement imparfait. Cette enveloppe impose des contraintes dures que le modèle ne peut pas contourner, même s'il " hallucine", dérive ou optimise de manière perverse.

Mais la propriété la plus critique reste la suivante : l'humain doit rester effectif dans la boucle sur les décisions à fort enjeu. L'article 14 de l'AI Act ne parle pas de supervision symbolique : il exige une supervision effective, c'est-à-dire capable d'interpréter, d'intervenir et de forcer un retour à l'état sûr en temps opportun. Toute architecture qui prétend se passer de cet humain effectif est juridiquement et moralement indéfendable dans les domaines à haut risque.

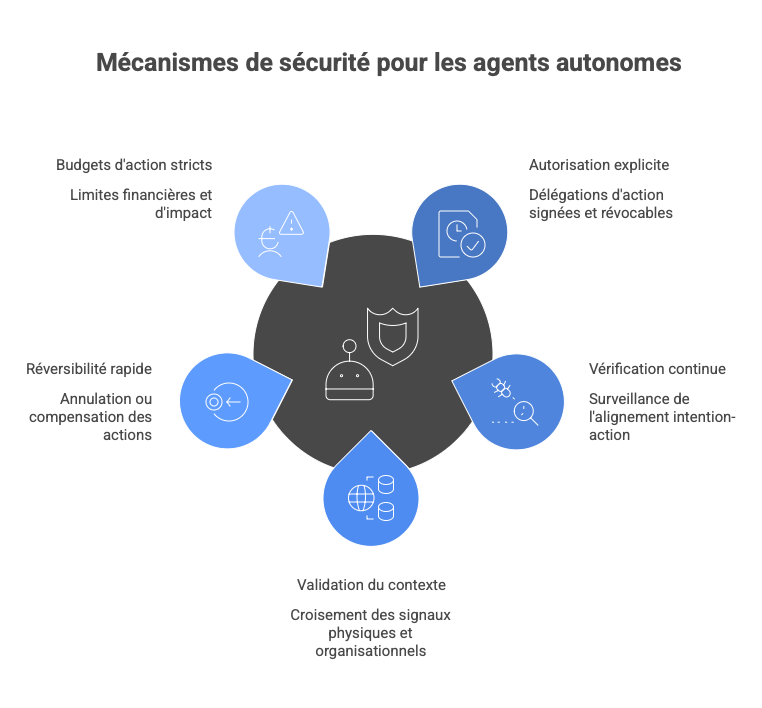

Cinq propriétés runtime doivent donc coexister :

-

Autorisation explicite, temporaire et révocable : toute délégation d'action est signée, bornée dans le temps et révocable instantanément. L'identité de l'agent est éphémère (générée à la volée via standards type SPIFFE + extensions runtime + Verifiable Credentials). Sans autorisation valide et fraîche il n'y a pas d'action réelle possible.

-

Vérification continue de l'alignement intention-action : le RegOS surveille en permanence l'écart entre l'intention déclarée / le mandat métier et la trajectoire réelle de raisonnement + l'action proposée (Policy-as-Code + comparaison sémantique). Toute dérive significative déclenche une arrêt automatique + escalade humaine forcée. On ne laisse pas l'agent "glisser" vers un objectif non mandaté.

-

Validation permanente du contexte opérationnel réel : le système croise en continu les signaux du monde physique et organisationnel (capteurs, métriques process, alertes NIS2/DORA, état des dépendances). Si le contexte sort des bandes de sécurité alors l'action est gelée et on passe immédiatement en supervision humaine renforcée. Même une inférence très confiante est bloquée si le réel a changé.

-

Réversibilité rapide et retour à un état sûr garanti : toute action engagée doit pouvoir être annulée ou compensée sans délai inacceptable (rollback logiciel + actionneurs de sécurité redondants pour le physique). Un plan de retour à l'état sûr est calculé et validé avant chaque délégation critique. L'humain (ou le système de sécurité câblé) doit pouvoir ramener le process dans une zone connue en quelques secondes/minutes.

-

Budgets d'action stricts et consommables : chaque agent dispose d'un budget contraint et décroissant : montant financier, nombre d'étapes, impact physique maximal, volume d'information généré ... Lorsque le budget s'approche de zéro un arrêt progressif est mis en place et on bascule obligatoirement vers supervision humaine. L'autonomie n'est jamais infinie ; elle est une ressource finie et mesurable.

Ces cinq propriétés ne visent pas à rendre le comportement de l'IA déterministe — elles visent à rendre les conséquences de son comportement bornées et réversibles, même quand il se trompe gravement.

Elles créent donc les conditions nécessaires pour que l'humain reste effectivement dans la boucle :

- les actions ne peuvent pas s'enchaîner indéfiniment sans réévaluation humaine

- les dérives sont détectées tôt (et non après des millions d'euros ou des dommages physiques)

- l'humain dispose toujours d'un veto fort et d'un chemin de retour clair

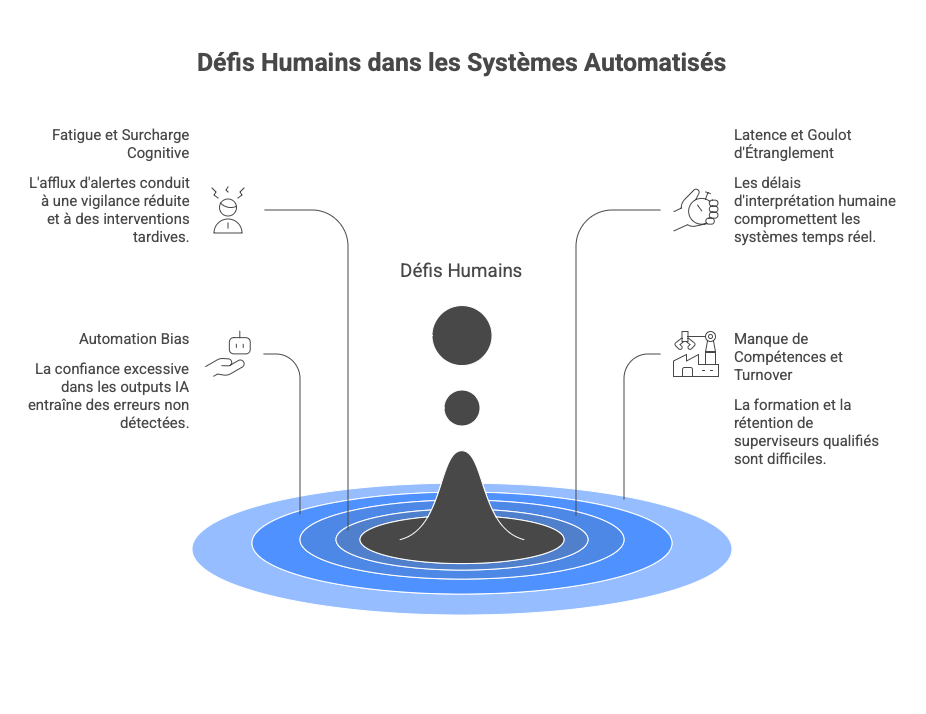

Pourtant la présence effective de l'humain dans la boucle reste le maillon le plus fragile. Les opérateurs font face à plusieurs défis structurels :

- Fatigue et surcharge cognitive : l'afflux d'alertes runtime (souvent des faux positifs) provoque de l'alert fatigue, menant à une dégradation de la vigilance et à des interventions tardives ou mécaniques.

- Latence et goulot d'étranglement : dans les systèmes temps réel (énergie, process chimiques, trading), le délai d'interprétation et de décision humaine peut compromettre la réversibilité promise.

- Automation bias et surconfiance : les opérateurs tendent à valider trop rapidement des outputs IA jugés "confiants", transférant subtilement des biais ou des erreurs non détectées.

- Manque de compétences et turnover : former et retenir des superviseurs capables d'interpréter des chaînes agentiques complexes devient un défi RH majeur dans les secteurs critiques.

Ces limites humaines soulignent que la maîtrise runtime ne peut pas reposer uniquement sur l'intervention manuelle : elle doit être hybride, avec des niveaux d'automatisation croissants pour les cas bas-risque et des escalades ultra-ciblées pour les décisions existentielles. Sans cela, l'article 14 de l'AI Act risque de rester une obligation formelle plutôt qu'une garantie effective.

En résumé : on ne rend pas le probabiliste déterministe. On le contient dans une cage dont les barreaux sont déterministes, dont les portes sont verrouillées par des politiques opposables, et dont la clé reste dans la main d'un opérateur formé et alerté en temps utile.

C'est seulement à cette condition que l'autonomie IA peut passer de prototype risqué à actif industriel assurable et déployable à grande échelle dans les secteurs régulés.

La maîtrise comme avantage concurrentiel mesurable

La maîtrise runtime de l'action n'est plus une contrainte défensive : elle est devenue un levier économique direct et quantifiable. Dans les marchés régulés (finance, énergie, santé, infrastructures critiques), l'absence de garde-fous runtime sur l'autonomie IA démultiplie les risques. Le coût de la preuve explose : reconstruction forensique lourde, audits externes répétés, réserves de risque accrues, exclusions assurantielles ou primes prohibitives. À l'inverse, une maîtrise systémique – autorisation temporaire, budgets d'action, réversibilité, override effectif – transforme le risque en actif stratégique.

Les premiers signaux quantitatifs de 2026-2027 sont déjà visibles. Les organisations qui démontrent une capacité à borner, révoquer et auditer en temps réel les actions IA accèdent plus facilement aux secteurs les plus rémunérateurs : biométrie à haut risque, systèmes de décision en infrastructures critiques, scoring financier ou médical sous AI Act. Ces zones, autrefois évitées pour leur complexité réglementaire, deviennent un moat : barrière à l'entrée prohibitive pour les concurrents moins matures.

Par exemples:

- IBM (via watsonx.governance) positionne explicitement sa plateforme comme un outil unifié pour la gouvernance et la sécurité agentique, avec monitoring runtime continu (drift, bias, performance), compliance accelerators pour l'EU AI Act (high-risk mapping, fact sheets, audits), et intégration Guardium AI Security pour détecter shadow agents et runtime risks. Cela ouvre les marchés finance/santé/infrastructures critiques en Europe, où la preuve de maîtrise runtime réduit les délais de certification et renforce la position assurantielle [https://newsroom.ibm.com/2025-06-18-ibm-introduces-industry-first-software-to-unify-agentic-governance-and-security] et [https://www.ibm.com/products/watsonx-governance].

- Anthropic (Claude) avance avec une constitution renforcée et runtime controls (guidelines compliance, tool integrations sécurisées), positionnant Claude pour regulated industries (finance, healthcare, justice) via transparency et oversight effectif aligné EU AI Act/Code of Practice [https://www.anthropic.com/news/claude-new-constitution].

Côté assurance, la corrélation est de plus en plus explicite. Les polices cyber et responsabilité produit intègrent désormais des exigences renforcées de gouvernance et de contrôles de sécurité, influencées par NIS2, DORA et le Cyber Resilience Act. Les entreprises capables de démontrer une maturité élevée en matière de gestion des risques cyber – notamment via des contrôles robustes, une supervision effective et une traçabilité des actions – obtiennent des conditions plus favorables.

Selon le rapport Aon " Cyber 2026: Evolving Threats Demand Strategic Leadership " (27 janvier 2026) [https://www.aon.com/en/insights/articles/cyber-2026-evolving-threats-demand-strategic-leadership], les assureurs exigent de plus en plus une gouvernance claire et des contrôles renforcés face aux risques IA, tandis que le rapport WTW " Cyber Risk: A Look Ahead to 2026 " (3 février 2026) [https://www.wtwco.com/en-us/insights/2026/02/cyber-risk-a-look-ahead-to-2026] note des opportunités de réductions de primes et d'expansion de couverture pour les risques bien maîtrisés.

Dans un marché softening, des baisses moyennes de primes de l'ordre de 7 à 15 % ont été observées en 2025 pour les acheteurs démontrant une amélioration significative de leurs contrôles de sécurité critiques (Aon North America Cyber Risk Report, Q1 2025 - [https://www.aon.com/cyber-risk-report/north-america-cyber-risk-maturity-grows-amid-systemic-cyber-events]). Les cas les plus matures bénéficient également d'une extension des limites de couverture sans surcoût proportionnel, comme indiqué dans le Q4 2025 Global Insurance Market Overview d'Aon [https://www.aon.com/en/insights/reports/global-insurance-market-insights/q4-2025-overview].

La démonstration d'une résilience opérationnelle forte, alignée sur les principes de la " Forteresse des Flux " et de la maîtrise runtime de l'action, renforce ainsi directement la position assurantielle et réduit le coût global du risque.

Les retours sur investissement concrets :

- Un agent supply-chain borné par un budget d'action (montant max engagé, nombre d'étapes, fournisseurs autorisés) réduit les litiges fournisseurs et les surcoûts d'urgence tout en maintenant une traçabilité opposable en cas d'enquête DORA.

- Un système de contrôle de procédé industriel avec override humain immédiat et rollback déterministe divise les temps d'arrêt non planifiés, préservant des dizaines de millions d'euros de production annuelle dans l'énergie ou la chimie.

- Des garde-fous runtime sur un modèle génératif multimodal (rédaction réglementaire, synthèse médicale) divisent les incidents de réputation ou de biais discriminants, évitant des amendes AI Act et des actions collectives massives.

Ces gains ne sont pas anecdotiques : ils se traduisent directement dans le P&L via une baisse du coût du capital (réserves de risque allégées), une accélération des déploiements (moins de revues tardives Legal/Compliance) et une prime de confiance commerciale (préférence dans les appels d'offres publics ou critiques).

En résumé : sans maîtrise runtime, l'IA industrialisée génère plus de passif que de valeur. Avec maîtrise, elle devient un multiplicateur économique : accès marché élargi, coût de risque maîtrisé, assurabilité améliorée, time-to-value accéléré. Le RegOS, en codifiant ces cinq propriétés (autorisation temporaire, légitimité d'intention, adéquation contexte, réversibilité, budgets d'action), transforme la conformité en compétitivité mesurable – exactement comme la forge l'a fait pour la donnée et les pipelines.

Conclusion – La maîtrise devient la nouvelle monnaie de l'IA industrialisée

La maîtrise de l'action transforme la conformité de simple fonction système (article 1) en propriété runtime exécutable dans la forge de confiance (article 2). Elle rend la donnée véritablement assurable et monétisable sous contrainte (article 3), car une donnée n'a de valeur durable que si les actions qu'elle déclenche restent traçables, bornées et réversibles. Elle fait des flux la surface critique de résilience (article 4), mais transforme ces flux en actifs stratégiques uniquement quand leur cinétique est maîtrisée en temps réel. Enfin, elle donne tout son sens à l'Identity of Action (article 5) : l'imputabilité causale n'est pas une fin en soi, elle n'est soutenable à l'échelle industrielle que si l'organisation conserve en permanence la capacité de borner, d'override, de révoquer ou d'arrêter une délégation avant que l'action ne devienne irréversible et dommageable.

La maîtrise au runtime complète les unités de compte de la valeur économique de l'autonomie IA. La délégation multiplie les points de contact entre IA et responsabilité réelle — ordres financiers, réglages physiques critiques, décisions réglementaires, diagnostics automatisés. Or l'article 14 de l'EU AI Act impose pour les systèmes à haut risque une supervision humaine effective : interfaces adaptées, capacité à interpréter les sorties, à intervenir, à override ou à stopper le système en toute sécurité, avec pour objectif explicite de prévenir ou minimiser les risques pour la santé, la sécurité et les droits fondamentaux (Article 14 – EU AI Act). Une alerte passive ou un simple log post-incident ne suffit plus ; la maîtrise doit être opposable en runtime.

Les organisations qui sauront imposer ces cinq propriétés essentielles — autorisation temporaire, légitimité d'intention vérifiée, adéquation contextuelle continue, réversibilité rapide, budgets d'action stricts — ne se contenteront pas de survivre aux audits NIS2, DORA, AI Act et Cyber Resilience Act. Elles obtiendront :

Les entreprises qui sauront borner l'action et l'influence de l'IA sans l'étouffer obtiendront non seulement une avance technique, mais la licence économique, juridique et sociale d'opérer dans l'Europe régulée. Les autres resteront cantonnés à des prototypes non viables ou à des marchés low-risk à faible valeur ajoutée.

La maîtrise n'est pas un frein à l'innovation : elle en est devenue le carburant le plus rare et le plus stratégique.

Lego II - RegOS - Sac 6

Les opinions exprimées dans cet article sont strictement personnelles et ne reflètent pas nécessairement celles de mon employeur. Les contenus sont fournis à titre informatif et ne constituent pas un conseil juridique. Cet article explore des concepts architecturaux émergents et analyse des tendances de marché. RegOS est ici une proposition conceptuelle personnelle et non propriétaire — un cadre d'ingénierie systémique que j'explore pour contribuer au débat public sur la conformité IA industrialisée en Europe.