L'AI EU Rulebook vu comme un moat

On entend souvent, outre-Atlantique, une critique récurrente : "L’Europe se tire une balle dans le pied avec son AI EU Rulebook. Trop lourd, trop complexe, trop tôt."

Pourtant, la maîtrise des règles du jeu de la deuxième puissance économique mondiale offre un avantage concurrentiel dès lors que nos industries évitent de considérer le "mille-feuille réglementaire" (AI Act, Data Act, CRA, PLD) comme un frein. C'est, au contraire, l'opportunité de bâtir ce que Warren Buffett définit comme l'attribut essentiel d'une entreprise pérenne :

"A truly great business must have an enduring 'moat' that protects excellent returns on invested capital."

Et si nous regardions la régulation comme une structure de marché ? Et si nous transformions la conformité en avantage concurrentiel structurel et en douve défensive infranchissable ?

Dans les systèmes critiques (Santé, Industrie, Finance), l'adoption de l'IA ne se fera pas sur la promesse de "magie", mais sur la garantie de robustesse. L'AI Act, en imposant des standards élevés pour les systèmes à "Haut Risque", crée un filtre de marché impitoyable. Ce qui semble être une contrainte est en réalité la promesse de la "Deutsche Qualität". Là où les acteurs de la "Tech légère" voient un mur, les industriels doivent voir une route balisée. Ainsi, au lieu d'éviter les cas d'usage "High Risk", ciblez-les. C'est là que se trouve la prime de confiance. Vendez des solutions "Enterprise-Grade" que les startups non conformes ne pourront jamais offrir aux grands comptes.

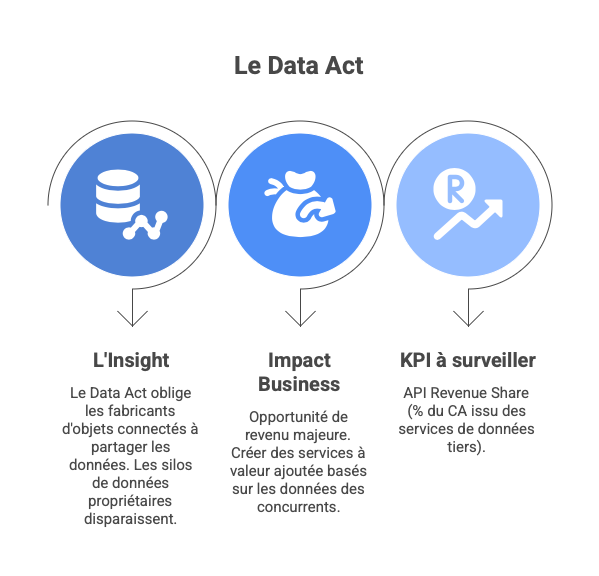

Le couple RGPD + AI Act force l'émergence d'architectures souveraines, mais c'est le "Data Act" qui rebat véritablement les cartes de la valeur. Il marque la fin du monopole des fabricants sur la donnée IoT. Les "silos" de données propriétaires sautent juridiquement. Nous avons désormais les armes pour exiger l'accès aux données du terrain opérationnel, là où la valeur se crée. Passez de la défensive à l'offensive. Créez des services à valeur ajoutée (maintenance prédictive, optimisation) basés sur les données des équipements de vos concurrents ou partenaires.

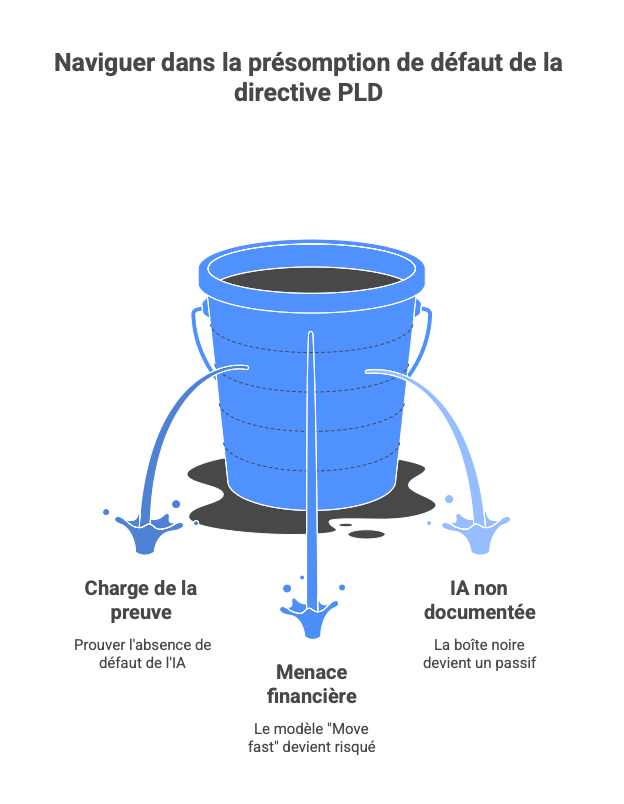

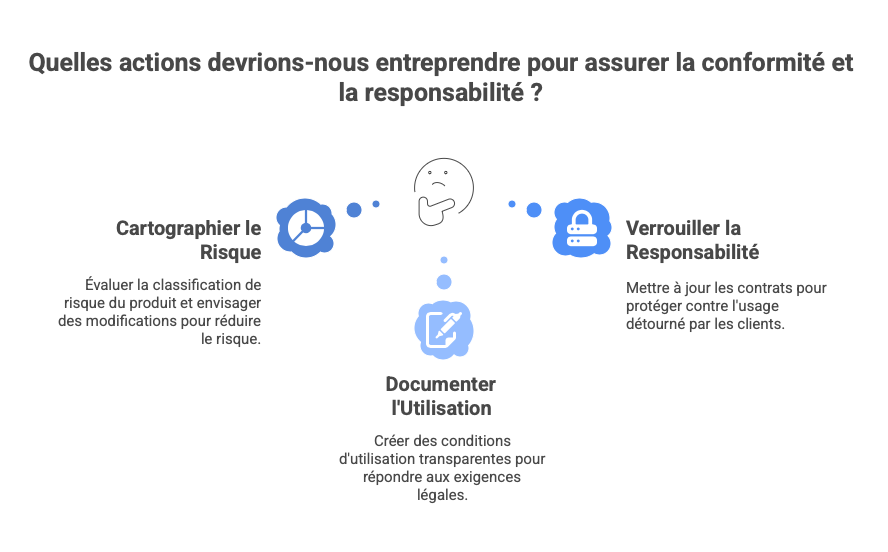

Le piège serait de traiter la conformité via un "Excel juridique". Il faut industrialiser cette gouvernance au cœur de la stack technologique (DevSecMLOps/LLMOps). Quand la nouvelle directive sur la responsabilité des produits introduit une présomption de causalité; il convient de mettre en place des gardes-fous pour prouver que votre IA a subi un panel de tests exhaustifs, car c'est désormais au fabricant de prouver qu'il n'est pas en faute.

Le modèle "Move fast and break things" devient suicidaire. Vos usines logicielles doivent devenir des "générateurs de preuves". Traçabilité native, cybersécurité by design, audit intégré. Ceux qui intègrent ces briques aujourd'hui vendront demain des solutions "AI Act Ready".

Face à ce paysage, deux postures gagnantes émergent selon votre taille. L'ère du flou artistique est terminée :

-

Pour les Grands Groupes, la stratégie de la "Forteresse" : utilisez la complexité réglementaire comme barrière à l'entrée. En transformant la conformité en standard industriel, vous rendez le marché inaccessible aux nouveaux entrants qui n'ont pas vos processus qualité. Vous ne vendez plus de l'IA, vous vendez de la sécurité juridique.

-

Pour les Startups & TPE, la stratégie du "Hors-bord" : n'essayez pas de construire la douve (trop cher), mais naviguez avec agilité en modifiant légèrement une feature pour sortir de la classification "Haut Risque" et arrivez avec un "Trust Pack" (conformité clé en main) pour devenir des fournisseurs "sans risque".

L'Europe ne nous demande pas simplement de "respecter les règles". Elle nous donne l'opportunité de définir le standard mondial de l'IA industrielle. C'est le moment de passer d'une posture de compliance défensive à une stratégie de valorisation offensive. La complexité, quand elle est maîtrisée, est votre meilleur Moat.

Nous avons l'avantage d'être sur le marché européen au plus proche de ces institutions, sur notre sol nous sommes tous à la même enseigne, les autres pays devant se plier à nos règles sont clairement désavantagées, profitons-en !

Lego I sac 3

Les opinions exprimées dans cet article sont strictement personnelles et ne reflètent pas nécessairement celles de mon employeur. Les contenus sont fournis à titre informatif et ne constituent pas un conseil juridique.