De l’Innovation à l’Actif Industriel - Transformer les initiatives IA en créateurs de valeur durable

Alors que l’enthousiasme pour les agents autonomes et les modèles de dernière génération reste fort, la réalité opérationnelle est plus nuancée. Selon le rapport The GenAI Divide: State of AI in Business 2025 du MIT Media Lab (Project NANDA), 95 % des initiatives GenAI n’ont pas d’impact mesurable sur le P&L (Fortune - MIT Report: 95% of Generative AI Pilots Failing CFO Scrutiny). Gartner observe quant à lui que près de 50 % des projets (GenAI project failure) sont abandonnés après la phase de PoC, tandis que la RAND Corporation attribue plus de 80 % des échecs à la qualité des données et à une infrastructure inadaptée(The Root Causes of Failure for Artificial Intelligence).

Aujourd'hui, un nouveau facteur amplifie le risque, les législations autour de la traçabilité. L’argument du Fair Use s’effondre face aux nouvelles régulations qui imposent une transparence chirurgicale.

Il est temps de passer d’une logique d’innovation spectacle à celle de la construction d’actifs industriels IA. Cela suppose une approche holistique qui intègre étroitement les dimensions techniques, business et légales/réglementaires.

Pourquoi la plupart des initiatives restent bloquées ?

- Les équipes excellent souvent dans le développement rapide de démonstrateurs performants (RAG, agents, optimisation). Ces PoC, généralement situés entre les TRL 3 et 5, jouent un rôle essentiel dans l’exploration et la validation rapide d’idées. Cependant, ils sont fréquemment construits sur des fondations fragiles : données insuffisamment qualifiées, modèles non versionnés, pipelines manuels et absence d’observabilité en production. Sans une stratégie claire de montée en maturité vers les TRL 6 à 9, la dette technique devient souvent insurmontable lors du passage à l’échelle.

- Beaucoup de PoC sont lancés sans alignement clair avec les priorités stratégiques ni estimation réaliste des coûts (inférence, maintenance, retraining). Le ROI reste théorique, et la réutilisabilité des actifs entre équipes ou business units est rarement anticipée. Résultat : des centres de coûts plutôt que des actifs générateurs de marge.

- Avec l’entrée en application progressive de l’AI Act, la traçabilité, la gestion des risques, la transparence et la conformité RGPD deviennent des exigences non négociables. Or, trop de projets traitent ces aspects en fin de cycle, ce qui entraîne des blocages ou des rework coûteux. Aujourd'hui, ce risque devient systémique : l’Article 50 de l’AI Act devient exécutoire le 2 août 2026. Les fournisseurs de modèles (GPAI) devront publier un résumé détaillé des données d’entraînement (EU AI Act 2026: New Rules for Training Data - Scalevise).

Un actif IA ne peut créer de valeur durable que s’il est techniquement robuste, économiquement viable et juridiquement responsable.

Le tournant radical de la traçabilité

Le « Digital Omnibus » agit comme un « patch » de simplification pour harmoniser l’EU AI Act, le RGPD et la cybersécurité.

1. Le Cadre Légal : L’effet « Digital Omnibus »

L’échéance clé arrive le 2 août 2026 : l’Article 50 de l’AI Act devient exécutoire. Les fournisseurs de modèles (GPAI) devront publier un résumé détaillé des données d’entraînement (EU AI Act 2026: New Rules for Training Data - Scalevise). Aux USA, le Federal CLEAR Act (mars 2026) emboîte le pas à l’Europe en obligeant le dépôt d’un inventaire des œuvres sous copyright utilisées dans les datasets auprès du Copyright Office (Text - S.3813 - CLEAR Act).

2. L’Impact Technique : Du Web Scraping au « Data Lineage »

La norme C2PA 2.3 est devenue le standard industriel pour le tatouage numérique. Ce n’est plus une option mais une nécessité pour prouver qu’un contenu est IA ou non (C2PA Content Credentials 2.3 - C2PA News 2026). Les protocoles comme le « AI-robots.txt » sont désormais standardisés. Techniquement, les pipelines d’entraînement doivent intégrer des filtres automatiques qui excluent les sources ayant activé leur droit de réserve. Le plus gros risque technique en 2026 est l’Injonction de Suppression : si un dataset est jugé illicite, le modèle doit être ré-entraîné (coût colossal), d’où l’émergence des techniques de Machine Unlearning (Softwareseni - EU AI Act and Content Provenance).

3. L’Impact Business : La prime à l’« IA Éthique »

La législation crée une nouvelle barrière à l’entrée qui favorise les géants possédant déjà des catalogues. En 2026, 76 % des entreprises préfèrent acheter des solutions IA sur étagère (SaaS) plutôt que d’entraîner leurs propres modèles, afin d'externaliser la conformité technique du modèle (données d'entraînement, transparence) vers le fournisseur (AI Training for Business 2026 - TechClass). Toutefois, l'entreprise reste juridiquement "Déployeur" : elle conserve la responsabilité de l'usage, de la surveillance humaine et de la non-discrimination des résultats dans ses processus métiers. Cette approche SaaS « Clean AI » représente surtout une voie réaliste et accessible pour les PME et entreprises de taille intermédiaire. Elles peuvent ainsi s’en sortir sans disposer des ressources colossales nécessaires à la construction d’une Data Moat propriétaire, tout en accélérant fortement leur time-to-value. Cependant, il est capital de bien garder à l’esprit que le recours à un fournisseur SaaS n’efface pas la responsabilité du Deployeur. L’entreprise reste pleinement responsable devant la loi de l’usage concret de l’IA dans ses processus métiers, de la mise en place d’une surveillance humaine appropriée, de la non-discrimination des résultats et de la conformité globale des cas d’usage.

On voit apparaître un marché de la donnée « premium » et « certifiée sans copyright ». Adobe et Apple dominent grâce à leurs accords de licence massifs, tandis que les modèles « Open » non-sourcés subissent une décote de confiance auprès des directions juridiques. Le fossé concurrentiel ne se joue plus sur l’architecture du modèle, mais sur la possession d’une Data Moat exclusive et légalement propre (Apple Intelligence vs Adobe - TradingView 2026).

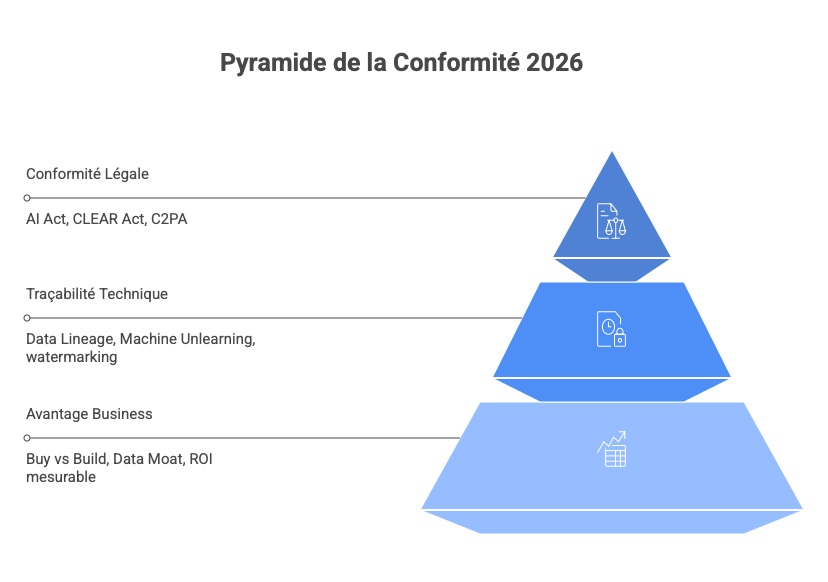

Synthèse : La Pyramide de la Conformité

Au sommet : Conformité Légale (AI Act + CLEAR Act + C2PA).

Au milieu : Traçabilité Technique (Data Lineage + Machine Unlearning + watermarking).

À la base : Avantage Business (Buy vs Build + Data Moat + ROI mesurable).

La « Clean AI » est devenue le nouveau « Bio » : plus chère, plus lente à produire, mais le seul moyen d’entrer sur le marché institutionnel.

Les défis concrets des responsables sur le terrain

Les témoignages et analyses récentes d’exécutifs mettent en lumière les freins concrets que rencontrent les organisations lors du passage des PoC à des actifs IA industriels, en croisant les dimensions technique, business et légale/réglementaire.

Rob Purinton, Chief AI Officer chez AdventHealth (l’un des principaux systèmes de santé américains), illustre la tension entre accélération et gouvernance : « AI universally compresses time, so leadership’s job is to hunt for bottlenecks and constraints, then deliberately decide where to slow down and where speed creates advantage. Governance should steer AI investment, not stall it. » Ce rôle de Chief AI Officer intègre directement la technique (goulot d’étranglement dans les pipelines), le business (décisions d’investissement et ROI) et le légal (gouvernance pour éviter les risques réglementaires) (Rob Purinton).

Shez Partovi, Chief Innovation Officer chez Philips, met quant à lui l’accent sur l’impact de la conformité EU AI Act sur l’innovation. Il explique que les grandes entreprises comme Philips peuvent absorber les coûts de certification, mais que les startups risquent d’être exclues : « Companies like Philips may actually be positioned to overcome that headwind because of our size and scale, but young companies, startups, forget it. » Il ajoute que la réglementation pourrait conduire à une innovation plus rapide en Amérique du Nord qu’en Europe : « It would be a shame to bring innovation faster in the North America market than in the European market for a European company. » Son poste croise innovation technique, stratégie business et contraintes légales, soulignant le risque d’une « fuite » de l’innovation hors d’Europe (CIO).

L’intégration de l’IA avec les systèmes legacy constitue un frein majeur. Les infrastructures anciennes — données silotées, ERP historiques et mainframes — n’ont pas été conçues pour les workloads IA modernes (scalabilité, data lineage en temps réel, provenance C2PA). Selon une analyse dédiée aux défis des CTO, ces systèmes créent des silos de données, des problèmes de sécurité et des contraintes de ROI qui compliquent fortement la mise en place de data lineage, de watermarking C2PA et de machine unlearning à grande échelle, avec des coûts de migration et de ré-entraînement souvent sous-estimés (https://www.gartner.com/en/articles/cio-challenges).

Dans les entreprises de taille intermédiaire et les PME, les risques systémiques posés par l’Article 50 de l’AI Act (exécutoire le 2 août 2026, qui impose un résumé détaillé des données d’entraînement pour les GPAI) et les exigences de provenance sont jugés critiques. Face aux coûts élevés de conformité pour les « providers », la grande majorité privilégie les solutions SaaS « Clean AI » plug-and-play. Cela leur permet de rester en position de « deployers », de transférer la responsabilité juridique au fournisseur, de limiter les coûts cachés (y compris le machine unlearning en cas d’injonction) et d’obtenir un time-to-value rapide.

Ces retours concrets, issus de leaders sectoriels, montrent que la réussite de l’industrialisation IA passe par une gouvernance proportionnée qui intègre dès les premières phases les trois piliers – technique (data lineage, MLOps), business (ROI réaliste, Buy vs Build) et légal (traçabilité C2PA, conformité Article 50) – sans étouffer l’expérimentation exploratoire.

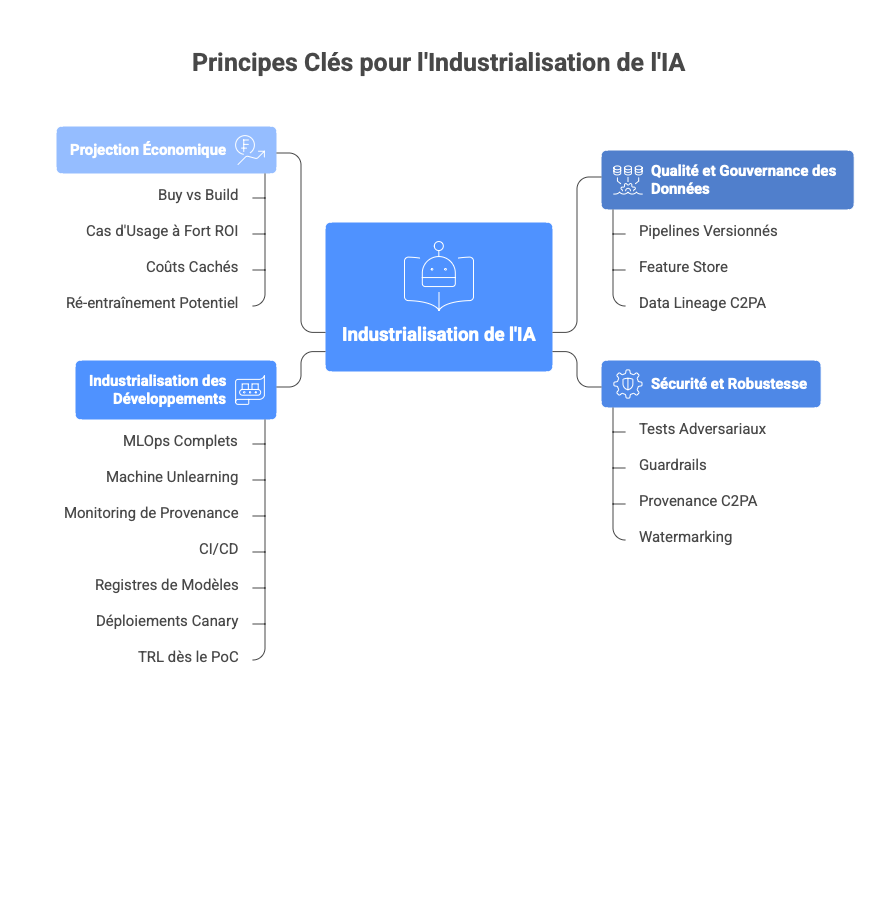

Les quatre principes clés pour réussir l’industrialisation

1. Placer la qualité et la gouvernance des données au cœur du projet dès l’origine

Pipelines versionnés + feature store + Data Lineage C2PA obligatoire. Les données doivent être non seulement de qualité, mais légalement propres (Softwareseni - EU AI Act and Content Provenance).

2. Concevoir la sécurité, la robustesse et la gestion des risques « by design »

Tests adversariaux + guardrails + provenance C2PA et watermarking (C2PA Content Credentials 2.3). Cela protège la réputation et la conformité ISO 42001 / NIST AI RMF.

3. Industrialiser par la modularité dès les premières itérations

Les MLOps doivent désormais garantir une agilité de ré-apprentissage. Plutôt que des modèles monolithiques, la norme devient l’usage d’architectures modulaires (PEFT, LoRA, Adapters). Ces techniques permettent de fine-tuner rapidement un modèle sur vos propres données métier tout en conservant la base « Clean » du modèle d’origine. Elles offrent surtout une flexibilité essentielle face aux exigences réglementaires : en cas d’injonction de suppression, le Machine Unlearning chirurgical devient possible, permettant de dés-apprendre ou de neutraliser uniquement des capacités spécifiques sans ré-entraîner entièrement le modèle. Cela réduit considérablement les coûts, les délais et les risques opérationnels.

4. Intégrer une projection économique réaliste et continue

Avant tout scaling, comparer Buy vs Build (76 % des entreprises ont déjà tranché) (TechClass 2026). Prioriser les cas d’usage à fort ROI tout en intégrant les coûts cachés de conformité et de ré-entraînement potentiel.

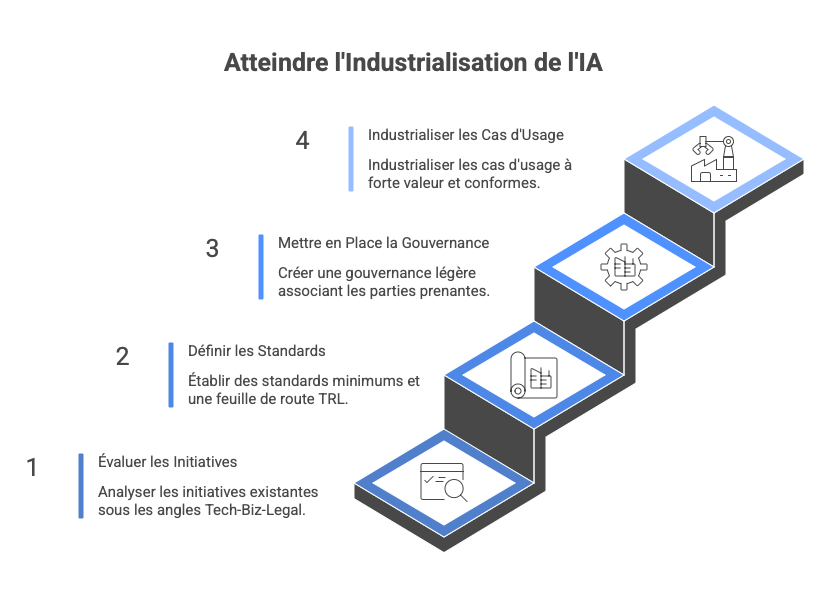

Une trajectoire adaptée à chaque organisation

- Évaluer rapidement le portefeuille d’initiatives existantes sous l’angle Tech-Biz-Legal et cartographier leur niveau de TRL actuel.

- Définir des standards minimums et une feuille de route TRL claire vers l’industrialisation.

- Mettre en place une gouvernance légère associant Métier, IA, IT et Risques/Juridique.

- Progresser par itérations : industrialiser d’abord les cas d’usage à plus forte valeur et conformes.

Pour les grands groupes : plateformes communes + standards enterprise.

Pour les PME : services managés hyperscalers + solutions SaaS « Clean AI » pour un time-to-value rapide et sans risque juridique.

Conclusion

L’industrialisation des actifs IA ne doit plus être une étape finale, mais une exigence posée dès la conception. Aujourd'hui, intégrer étroitement les dimensions techniques, business et légales tout en respectant la logique de maturité TRL n’est plus une option : c’est la condition de survie.

Il est essentiel d'éviter de se retrouver avec un modèle « toxique » que vous ne pouvez plus déployer en Europe. La « Clean AI » est devenue le nouveau « Bio » : c’est plus cher, c’est plus lent à produire, mais c’est le seul moyen d’entrer sur le marché institutionnel.

Lego VI - From innovation to Industrial asset

Les opinions exprimées dans cet article sont strictement personnelles et ne reflètent pas nécessairement celles de mon employeur. Les contenus sont fournis à titre informatif et ne constituent pas un conseil juridique. Cet article explore des concepts architecturaux émergents et analyse des tendances de marché (Gartner, Forrester, Scalevise, C2PA, European Parliament, MIT NANDA). Les solutions technologiques citées le sont à titre d’exemple et ne préjugent pas des choix technologiques ou des partenariats de mon employeur.