Le Risque "Shadow AI" & La Propriété Intellectuelle

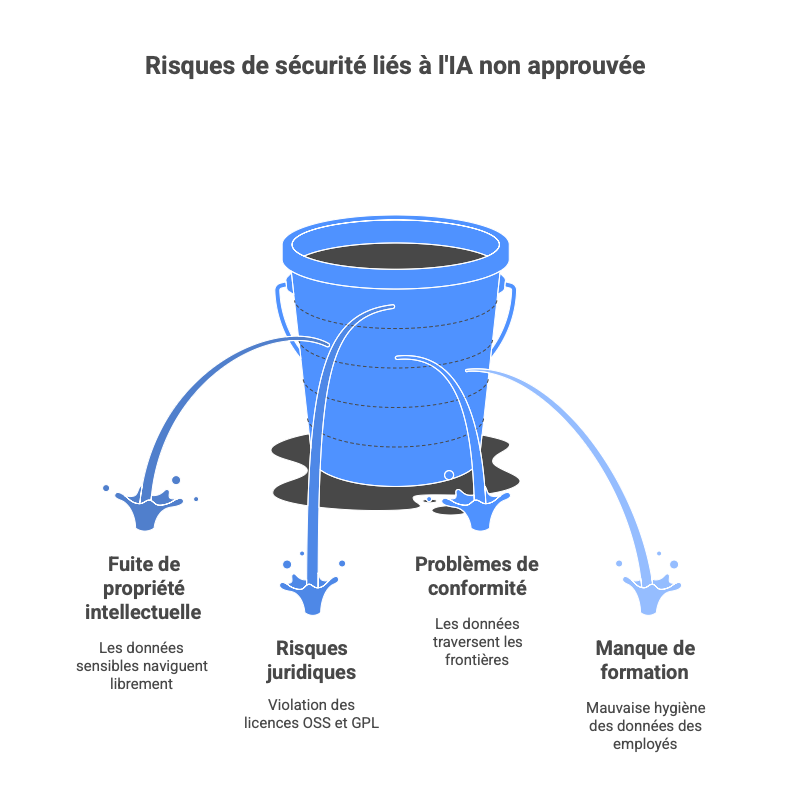

En interne, les employés utilisent des outils IA non approuvés pour aller plus vite (shadow ai) ... on a une fuite d'IP et derrière des prompts et des plombiers qui chassent toujours les champignons dans les emails.

Le risque juridique monte, on génère du code, des contenus marketing ... que se passe-t-il quand le code généré vient d'un OSS sous GPL, que se passe-t-il quand des données sensibles naviguent tranquillement entre les continents ? Le "Shadow AI" risque de devenir la faille de cybersécurité n°1.

Dans ce contexte, il y a un fort intérêt à prendre des licences "Enterprise" qui garantissent la non-utilisation de tes données pour l'entraînement (ex: ChatGPT Enterprise, Azure OpenAI), il faut aussi former les équipes au "Data Hygiene" : aucune donnée client confidentielle dans un modèle public.